目录

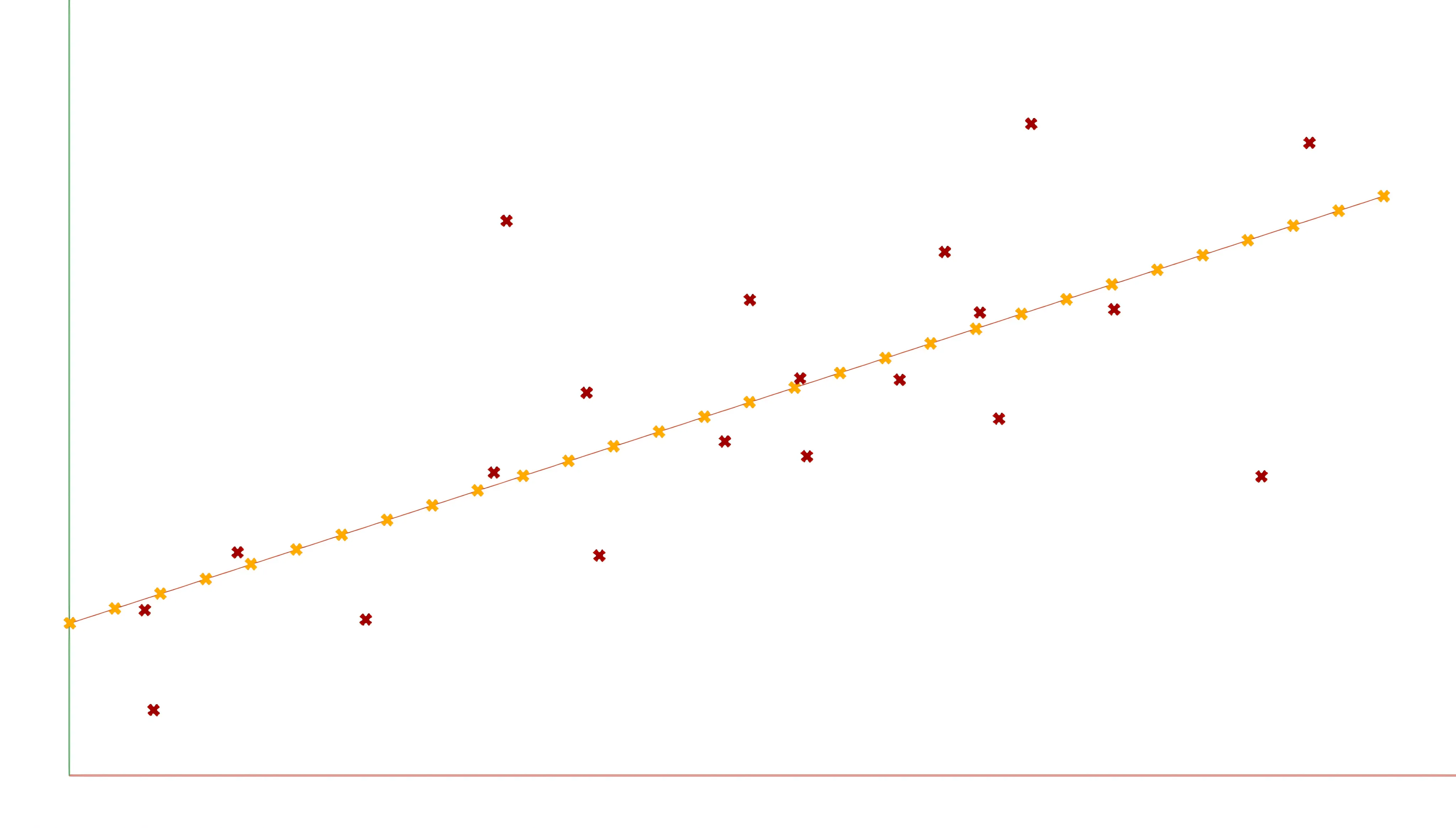

什么是回归(Regression)?

回归是机器学习领域中最常见的任务类型之一,它的目标是根据已知的特征(输入)来预测一个连续的数值(输出)。在实际应用中,当你需要预测数值结果而不是分类标签时,就可以使用回归模型。例如:

回归是机器学习领域中最常见的任务类型之一,它的目标是根据已知的特征(输入)来预测一个连续的数值(输出)。在实际应用中,当你需要预测数值结果而不是分类标签时,就可以使用回归模型。例如:

- 预测房产价格

- 预测销售额

- 预测保险索赔金额

- 预测股票涨跌幅度

- 预测能耗需求

在 ML.NET 中,回归任务通常会使用训练数据(特征和对应的真实数值标签)来训练出可用于数值预测的模型。

回归的应用场景

- 价格预测

- 预测房屋价格、股票价格、二手车价格、商品售价等。

- 需求预测

- 预测零售行业某一件商品的销售量或销量走向。

- 时间序列预测

- 虽然时间序列通常会用到更多的时序算法,但如果只是简单地想要针对数值结果做预测,也可以将其转换成回归问题,例如预测下一天市场需求、商场客流量等。

- 风控与保险

- 用于预测保险理赔金额、风险概率数值化等。

- 性能或指标预测

- 根据历史性能指标(如服务器的 CPU/GPU、内存占用)来预测未来使用情况。

ML.NET 中常见的回归训练器

ML.NET 提供了多种回归训练算法(“训练器”是 ML.NET 中对模型训练算法的称呼),以下为常用的几种:

- Stochastic Dual Coordinate Ascent (SDCA) Regressor

- 基于线性模型的算法,适合大规模数据。

- 收敛速度较快,对特征数据的要求相对高一些(如需要数值化、规范化等)。

- 适用于线性或接近线性的回归场景。

- Online Gradient Descent (OGD) Regressor

- 采用在线学习(Online Learning),能够在数据流环境中持续学习。

- 对内存需求小,可随时更新模型以反映最新的数据。

- 适合数据分布变化较为频繁的场景,或者使用流数据的预测场景。

- FastTree Regressor

- 基于梯度提升决策树(Gradient Boosted Decision Tree)的实现。

- 训练速度较快,能够捕捉到特征与标签之间更复杂的非线性关系。

- 对数据的特征工程要求不算高,在很多实际任务中有很好的表现。

- FastForest Regressor

- 随机森林(Random Forest)变体。

- 通过集成多个决策树减少过拟合,稳定性好。

- 预测阶段需要综合多个预测结果,往往能带来更稳健的表现。

- LightGBM Regressor

- Microsoft 推出的高性能梯度提升树(Gradient Boosting)实现,训练速度快,能处理大规模数据。

- 对稀疏特征具有良好支持,能准确地捕捉非线性关系。

- 需要注意参数调优,否则可能过拟合。

- FastTreeTweedie Regressor

- 适合对分布特殊或偏态分布场景(如保险定价、索赔数据)的预测。

- Tweedie 分布常用于对零通量较多、长尾特征的金融场景预测。

- LBFGS (Limited-memory Broyden–Fletcher–Goldfarb–Shanno) Regressor

- 经典的数值优化算法,适用于线性与广义线性模型。

- 对数据规模和特征工程有一定要求。

- 如果数据可以较好地满足线性假设,LBFGS 模型简单且可解释性较好。

- Generalized Additive Models (GAM) Regressor

- 兼具线性模型和树模型各自的优点,具有一定灵活性和可解释性。

- 更好地捕捉特征与目标之间的非线性关系。

主要特点与对比

- 线性模型 vs. 树模型

- 线性模型(如 SDCA、LBFGS 等):

- 训练速度快,对数据量大的场景表现良好。

- 对特征工程依赖较大,需要对特征进行较好的数值化、归一化、去量纲等处理。

- 模型简单,没有太强的非线性拟合能力,但可解释性好。

- 树模型(如 FastTree、FastForest、LightGBM 等):

- 能够捕捉复杂的特征关系,适用于非线性任务。

- 对数据预处理要求相对较小,往往可以处理缺失值、离散值等。

- 一些树模型对多核、GPU 有优化支持,训练效率较高,但需要注意调参。

- 线性模型(如 SDCA、LBFGS 等):

- 在线学习 vs. 批量学习

- 在线学习(如 OGD Regressor):

- 模型可以在不断到来的数据流中更新,不必批量训练全部数据。

- 特别适合数据分布随时间变化较快的场景。

- 批量学习(如 FastTree、LightGBM、SDCA 等):

- 需要先收集足够多的训练数据,然后一次性或分块读入训练。

- 适用于数据分布相对稳定的场景,易于在离线完成大规模训练。

- 在线学习(如 OGD Regressor):

回归任务的流程示例

使用 ML.NET 进行回归任务的一般流程如下:

- 数据准备

- 读取数据源,整理成格式化的

IDataView对象(通常可使用MLContext.Data.LoadFromTextFile或者数据库连接获取)。 - 特征工程:清洗数据、数值化、归一化、构造新特征等。

- 读取数据源,整理成格式化的

- 管线搭建

- 构建

Estimator,在管线中进行数据转换和算法训练。 - 例如:将文本特征进行编码、数值特征做归一化或缩放、选取合适的回归训练器(FastTree/LightGBM/SDCA 等)。

- 构建

- 模型训练

- 使用

Fit()方法将数据输入训练管线,生成模型。 - 训练完毕后,会产生一个

Transformer对象,可在预测阶段使用。

- 使用

- 模型评估

- 使用校验集(或者交叉验证)评估模型的性能指标,如均方误差(MSE)、均方根误差(RMSE)、R² 等。

- 根据评估结果调参或者更换算法,反复迭代。

- 模型预测

- 使用训练好的模型对新数据做数值预测。

- 部署至开发环境或生产环境,根据输入获取预测结果。

总结

回归是 ML.NET 支持的核心机器学习任务之一,用于预测连续数值。在选择哪种回归训练器时,需要考虑如下因素:

- 训练数据规模与特征质量(大规模数据倾向于使用基于决策树的集成算法或者经过优化的算法)。

- 需要捕捉的复杂度(线性模型 vs. 树模型)。

- 预测场景是否需要在线学习以及对延迟的要求。

- 是否需要对结果可解释性有更高要求(线性模型通常更可解释)。

得益于 ML.NET 的多种内置算法和数据转换管线,你可以方便地结合数据预处理与回归训练器,实现从数据读取到模型部署的端到端解决方案。通过持续地评估和优化模型,可以使你的回归预测结果更加准确,进而在真实业务中获得实际价值。

本文作者:技术老小子

本文链接:

版权声明:本博客所有文章除特别声明外,均采用 BY-NC-SA 许可协议。转载请注明出处!

目录