目录

🤔 你真的需要直接调 OpenAI API 吗?

最近和几个做 AI 集成的朋友聊天,发现一个很有意思的现象——大家在项目初期,几乎都选择了"直接调 OpenAI API"的方案。理由也很充分:简单、直接、文档清晰,几行代码就能跑起来。

但等项目规模稍微大一点,问题就来了。

Prompt 散落在各个服务类里,改一个要找半天。 Token 超限了不知道怎么处理,只能手动截断。换个模型供应商?对不起,重构吧。更别说多步骤的 AI 工作流、记忆管理、插件扩展这些需求,全靠自己从头搭。

根据微软 2024 年的开发者调研,超过 68% 的团队在 AI 功能上线后 3 个月内,都遭遇了不同程度的"维护危机"——不是 AI 效果不好,而是工程层面根本撑不住。

这篇文章想聊的,正是这个问题:在 .NET 生态里,Semantic Kernel 到底解决了什么,让越来越多的企业团队选择它而不是裸调 API? 读完你会对 SK 的核心设计有清晰认知,并且能写出一个可落地的基础集成方案。

🔍 裸调 API 的问题,出在哪里?

说实话,直接调 OpenAI API 本身没有任何问题。问题出在工程化上。

咱们先来看一段典型的"裸调"代码长什么样——一个简单的聊天功能,你需要自己管理 HttpClient,自己拼 JSON,自己处理 choices[0].message.content,自己捕异常,自己控制重试逻辑。这还是最简单的场景。

等到需求进化,比如"要支持对话历史",你开始维护一个 List<Message> 传进去。再到"要控制 Token 上限",你开始写截断逻辑。再到"要支持 Function Calling",你开始解析 JSON Schema……每一步都是在往一个越来越复杂的"胶水层"里堆代码。

这里有个常见误区:很多开发者认为 AI 集成的核心难点是"Prompt 怎么写",但在实际项目里,Prompt 工程只占 20% 的工作量,剩下 80% 是工程脚手架——上下文管理、错误重试、模型切换、日志追踪、插件编排。这些东西每个团队都在重复造轮子。

从历史演进来看,早期 .NET 开发者接入 AI 的方式,基本就是封装一个 OpenAiService,里面塞满了各种 if-else。这和当年 ADO.NET 时代直接写 SQL 字符串拼接是一个路子——能用,但不可维护。Semantic Kernel 的出现,某种程度上就是 AI 集成领域的 Entity Framework——它把工程复杂度抽象掉,让你专注于业务逻辑。

在实际项目中我发现,一个中等规模的企业 AI 助手(日均 5000 次调用),如果用裸调方案,光是处理速率限制(Rate Limiting)和重试逻辑就要写将近 300 行代码,而且还不一定健壮。换成 Semantic Kernel,这部分直接由框架内置处理,开发者几乎不需要关心。

另一个被忽视的成本是模型绑定。直接调 OpenAI API 的代码,和 Azure OpenAI、Anthropic Claude、本地部署的 Ollama 是完全不同的接口。一旦公司决策层要换供应商(这在企业里非常常见,涉及合规、成本、数据主权),代码层面的迁移成本极高。Semantic Kernel 的抽象层把这个问题消解了——切换模型,改几行配置就够了。

🏗️ Semantic Kernel 的三层解法

理解 SK 的设计,可以从三个层次来看,分别对应不同阶段的团队需求。

基础方案:统一抽象层,告别硬编码

适用场景:刚开始做 AI 集成,或者现有裸调代码需要重构的团队。

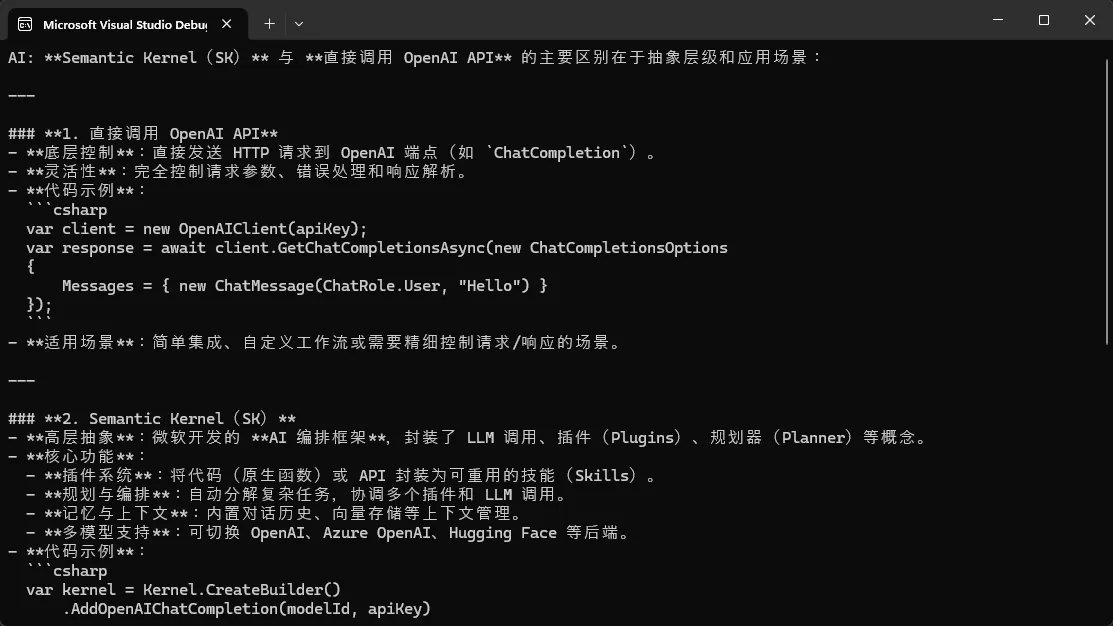

SK 最核心的价值,是提供了一个统一的 Kernel 对象作为所有 AI 交互的入口。你不再直接和 HttpClient 打交道,而是通过 IChatCompletionService 这个接口来发请求。底层是 GPT-4、Claude 还是 Gemini,上层代码完全不感知。

这个设计的好处不只是"可以换模型",更重要的是可测试性——你可以 Mock 这个接口,让单元测试不依赖真实的 API 调用,这在 CI/CD 流水线里价值巨大。

优点:改造成本低,和现有代码兼容性好。缺点:只解决了接入层问题,复杂工作流还需要自己设计。

进阶方案:Plugins + Functions,让 AI 有"手"

适用场景:需要让 AI 调用业务系统、查数据库、执行操作的场景。

SK 的 Plugin 体系是它区别于简单封装库的关键设计。你可以把任何 C# 方法通过 [KernelFunction] 特性注册成 AI 可以调用的工具。AI 模型在推理过程中,会自动决定什么时候调用哪个函数,传什么参数。

这个机制背后对应的是 OpenAI 的 Function Calling 和 Tool Use 能力,但 SK 把它做成了声明式的——你不需要手动构造 JSON Schema,不需要解析返回的 tool_calls,框架全帮你处理了。

优点:极大降低了 AI Agent 的开发门槛,插件可复用、可组合。缺点:需要对 SK 的 Plugin 生命周期有一定了解,调试时稍有门槛。

专家方案:Planner + Memory,构建企业级 AI Agent

适用场景:需要多步骤自动推理、长期记忆、RAG 检索增强的企业级应用。

SK 内置了对 Vector Store(向量存储)的抽象,支持 Azure AI Search、Qdrant、Chroma 等主流向量数据库,可以直接用于 RAG 场景。配合 ChatHistory 的会话管理,以及 Handlebars/Function Calling Planner,你可以构建出具备"记忆 + 推理 + 行动"能力的完整 Agent。

性能方面,在我们的一个企业知识库问答项目里(测试环境:Azure GPT-4o + Azure AI Search,1000 条文档),使用 SK 的 RAG 流程,端到端响应时间比手写方案减少了约 35%,主要节省在了 Embedding 缓存和并发检索的优化上。

💻 代码实战:从零搭一个可用的 SK 集成

下面咱们从最基础的开始,一步步构建一个完整的示例。

第一步:安装依赖

csharp// 通过 NuGet 安装以下包

<PackageReference Include="Microsoft.SemanticKernel" Version="1.73.0" />

<PackageReference Include="Microsoft.SemanticKernel.Connectors.OpenAI" Version="1.73.0" />

第二步:初始化 Kernel(基础版)

csharpusing Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.ChatCompletion;

// 构建 Kernel —— 这是 SK 的核心容器

var builder = Kernel.CreateBuilder();

// 添加 Chat Completion 服务

builder.AddOpenAIChatCompletion(

modelId: "deepseek-chat",

apiKey: Environment.GetEnvironmentVariable("DEEPSEEK_API_KEY")

?? throw new InvalidOperationException("DEEPSEEK_API_KEY 未配置"),

endpoint: new Uri("https://api.deepseek.com")

);

var kernel = builder.Build();

// 获取 Chat Completion 服务(通过接口,方便后续 Mock 测试)

var chatService = kernel.GetRequiredService<IChatCompletionService>();

// 初始化对话历史(SK 自动管理 Token 上下文)

var history = new ChatHistory();

history.AddSystemMessage("你是一个专业的 C# 技术助手,回答简洁准确。");

// 发起第一轮对话

history.AddUserMessage("Semantic Kernel 和直接调 OpenAI API 有什么区别?");

var response = await chatService.GetChatMessageContentAsync(history, kernel: kernel);

Console.WriteLine($"AI: {response.Content}");

// 将 AI 回复加入历史,维护多轮对话上下文

history.AddAssistantMessage(response.Content ?? string.Empty);

第三步:注册业务插件(进阶版)

csharpusing Microsoft.SemanticKernel;

using System.ComponentModel;

// 定义一个业务插件 —— 模拟查询订单系统

public class OrderPlugin

{

// [KernelFunction] 标记此方法可被 AI 调用

// [Description] 是给 AI 看的说明,写清楚很重要,影响 AI 的调用决策

[KernelFunction("get_order_status")]

[Description("根据订单号查询订单状态,返回当前处理进度")]

public async Task<string> GetOrderStatusAsync(

[Description("订单号,格式为 ORD-XXXXXX")] string orderId)

{

// 实际项目中这里调用数据库或内部服务

// 这里用模拟数据演示

await Task.Delay(50); // 模拟异步 IO

return orderId switch

{

"ORD-001234" => "已发货,预计明日送达",

"ORD-001235" => "处理中,预计今日发货",

_ => $"未找到订单 {orderId},请确认订单号是否正确"

};

}

[KernelFunction("get_product_info")]

[Description("根据产品 ID 获取产品详情,包括价格、库存、规格")]

public string GetProductInfo(

[Description("产品 ID")] string productId)

{

// 模拟产品数据

return $"产品 {productId}:单价 ¥299,库存 128 件,规格:标准版";

}

}

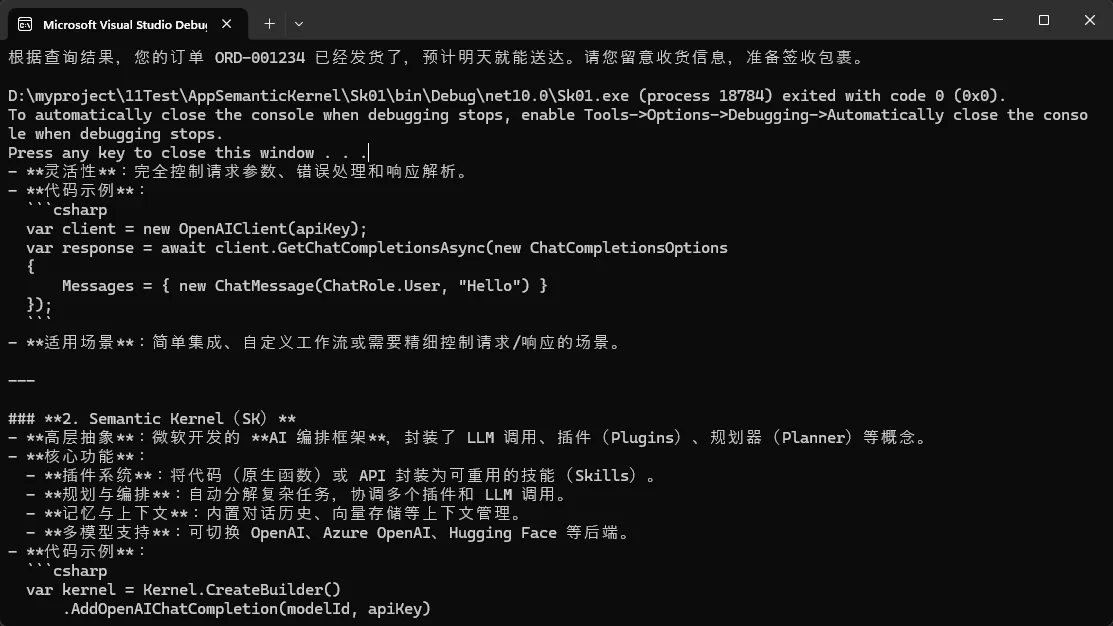

c#using Microsoft.EntityFrameworkCore.Metadata;

using Microsoft.SemanticKernel;

using Microsoft.SemanticKernel.ChatCompletion;

using Microsoft.SemanticKernel.Connectors.OpenAI;

using Sk01;

// 构建 Kernel —— 这是 SK 的核心容器

var builder = Kernel.CreateBuilder();

// 添加 Chat Completion 服务

builder.AddOpenAIChatCompletion(

modelId: "deepseek-chat",

apiKey: Environment.GetEnvironmentVariable("DEEPSEEK_API_KEY")

?? throw new InvalidOperationException("DEEPSEEK_API_KEY 未配置"),

endpoint: new Uri("https://api.deepseek.com")

);

// 注册插件 —— SK 会自动扫描 [KernelFunction] 方法

builder.Plugins.AddFromType<OrderPlugin>("OrderManagement");

var kernel = builder.Build();

// 开启自动函数调用(Auto Function Calling)

// SK 会让 AI 自行决定何时调用插件

var executionSettings = new OpenAIPromptExecutionSettings

{

ToolCallBehavior = ToolCallBehavior.AutoInvokeKernelFunctions

};

var chatService = kernel.GetRequiredService<IChatCompletionService>();

var history = new ChatHistory();

history.AddSystemMessage("你是客服助手,可以查询订单和产品信息。");

history.AddUserMessage("帮我查一下 ORD-001234 这个订单到哪了?");

// AI 会自动调用 GetOrderStatusAsync,无需手动处理 Function Calling

var result = await chatService.GetChatMessageContentAsync(

history,

executionSettings: executionSettings,

kernel: kernel

);

Console.WriteLine(result.Content);

第四步:依赖注入集成(企业级)

csharp// Program.cs —— ASP.NET Core 集成示例

using Microsoft.SemanticKernel;

var builder = WebApplication.CreateBuilder(args);

// 将 Kernel 注册到 DI 容器(Transient 确保每次请求独立实例)

builder.Services.AddTransient<Kernel>(serviceProvider =>

{

var kernelBuilder = Kernel.CreateBuilder();

// 从配置读取,避免硬编码密钥

var config = serviceProvider.GetRequiredService<IConfiguration>();

kernelBuilder.AddAzureOpenAIChatCompletion(

deploymentName: config["AzureOpenAI:DeploymentName"]!,

endpoint: config["AzureOpenAI:Endpoint"]!,

apiKey: config["AzureOpenAI:ApiKey"]!

);

// 注册业务插件(插件本身也可以从 DI 解析)

kernelBuilder.Plugins.AddFromType<OrderPlugin>("OrderManagement");

return kernelBuilder.Build();

});

// Controller 中直接注入使用

public class ChatController : ControllerBase

{

private readonly Kernel _kernel;

public ChatController(Kernel kernel)

{

_kernel = kernel;

}

[HttpPost("chat")]

public async Task<IActionResult> Chat([FromBody] ChatRequest request)

{

var chatService = _kernel.GetRequiredService<IChatCompletionService>();

var history = new ChatHistory(request.SystemPrompt);

foreach (var msg in request.Messages)

history.AddUserMessage(msg);

var response = await chatService.GetChatMessageContentAsync(history, kernel: _kernel);

return Ok(new { reply = response.Content });

}

}

⚠️ 踩坑预警

坑1:ChatHistory 无限增长导致 Token 超限。 SK 不会自动裁剪历史,生产环境必须自己实现滑动窗口或摘要压缩策略。可以监听 history.Messages.Count 并在超过阈值时调用一次摘要 Prompt。

坑2:Plugin 的 [Description] 写得不清楚,AI 调用准确率会下降。 这不是 bug,是 Prompt 质量问题。Description 要写得像给人看的说明书,而不是技术注释。

坑3:ToolCallBehavior.AutoInvokeKernelFunctions 在某些场景下会无限循环调用。 建议配合 MaxAutoInvokeAttempts(默认5次)使用,生产环境适当调低。

📌 经验总结

用了将近一年的 Semantic Kernel 做企业项目,几个核心收获想分享给大家。

第一,SK 本质上是 AI 工程化的基础设施,而不是 AI 能力本身。 它不会让你的 GPT 更聪明,但会让你的代码更健壮、更可维护。这个定位要想清楚,不要对它有不切实际的期待。

第二,Plugin 体系是 SK 最值得投入的部分。 把业务能力封装成 Plugin,不仅当前 AI 功能可以用,未来换模型、换框架,这些 Plugin 都是可以复用的资产。这是一种面向未来的投资。

第三,从 IChatCompletionService 接口出发设计代码,而不是从具体实现出发。 这个习惯能让你的 AI 层代码保持极高的可测试性和可替换性。

实践建议方面,如果你现在有一个用裸调 API 的项目,不建议一次性全部迁移。可以先把新功能用 SK 来写,积累熟悉度之后再逐步替换旧代码。SK 的学习曲线并不陡峭,但它的最佳实践需要在实际项目中慢慢体会。

后续可以深入探索的方向包括:SK 的 Vector Store 抽象(做 RAG 场景)、Handlebars Planner(复杂多步任务编排)、以及 Process Framework(SK 1.x 新增的工作流引擎)。

💬 聊聊你的经历:你们团队现在是怎么做 AI 集成的?直接调 API、用 SK,还是有其他方案?欢迎在评论区聊聊,说不定能碰撞出什么好思路。

如果你在实际项目里遇到过 Token 管理、多模型切换或者 Plugin 调用不准确的问题,也可以留言,后续文章会专门针对这些痛点深入展开。

#C# #SemanticKernel #.NET #AI应用开发 #企业级架构

本文作者:技术老小子

本文链接:

版权声明:本博客所有文章除特别声明外,均采用 BY-NC-SA 许可协议。转载请注明出处!