目录

🎯 开头:你以为卡的是网,其实卡的是“代码组织”

做工业现场 TCP 工具时,很多同学第一反应是:网不稳、设备慢、交换机有锅。真相常常更扎心——先把 Socket 写进窗体按钮事件里,再想要稳定并发、超时控制、自动重连、日志追踪,这事儿基本就像“边开车边焊底盘”。

我这几年在产线、MES、采集网关项目里见过太多同款:演示能跑,压一压就抖;设备一多,界面就假死;偶发断线后,日志只剩一句“发送失败”。

这篇文章就拿一个 .NET 8 WinForms 项目 AppTcpTry 来拆:从能用到靠谱,咱们怎么把它做成一个可维护、可扩展、可诊断的工业 TCP 客户端。不是空谈。带代码、带对比、带踩坑。

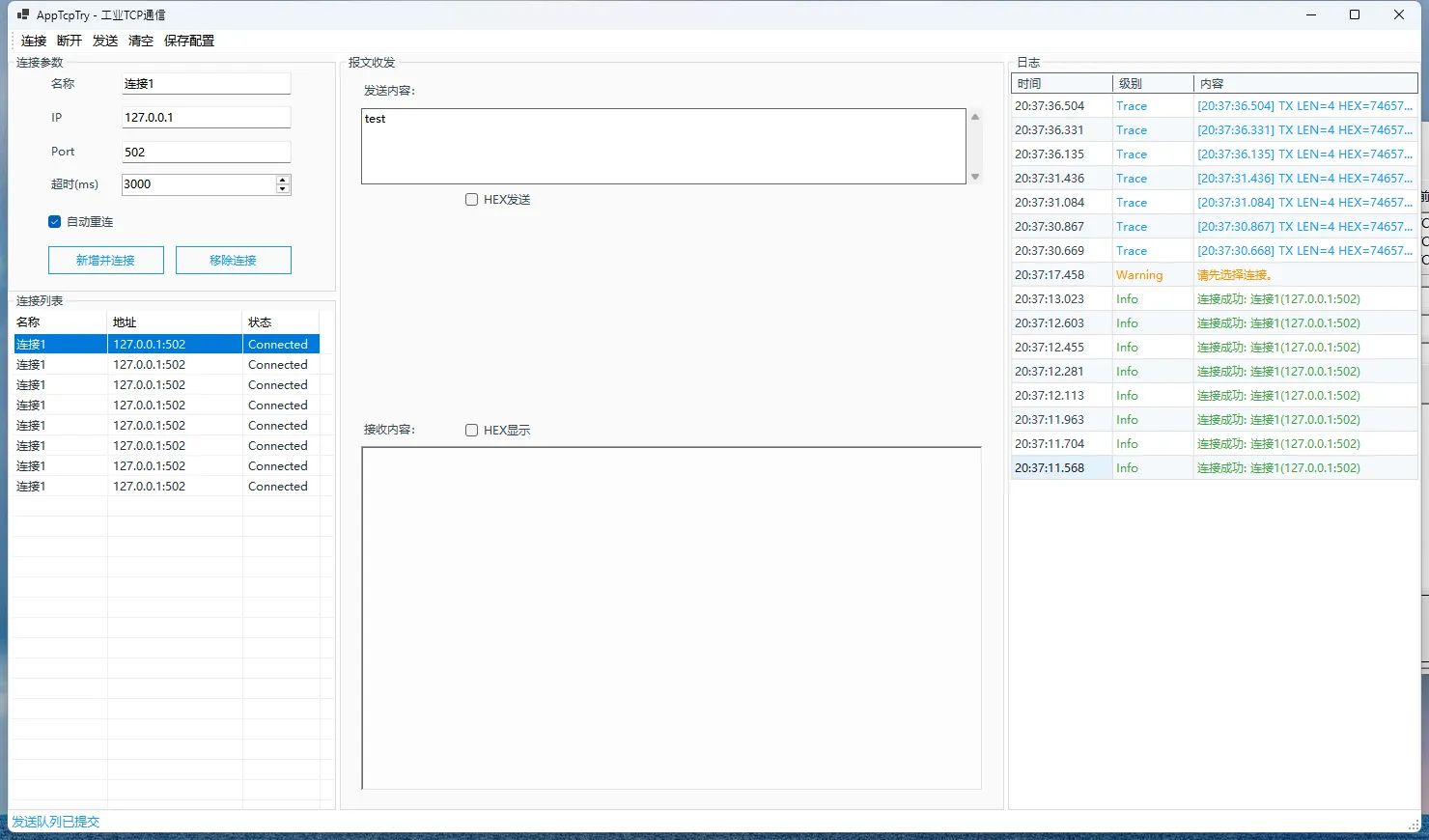

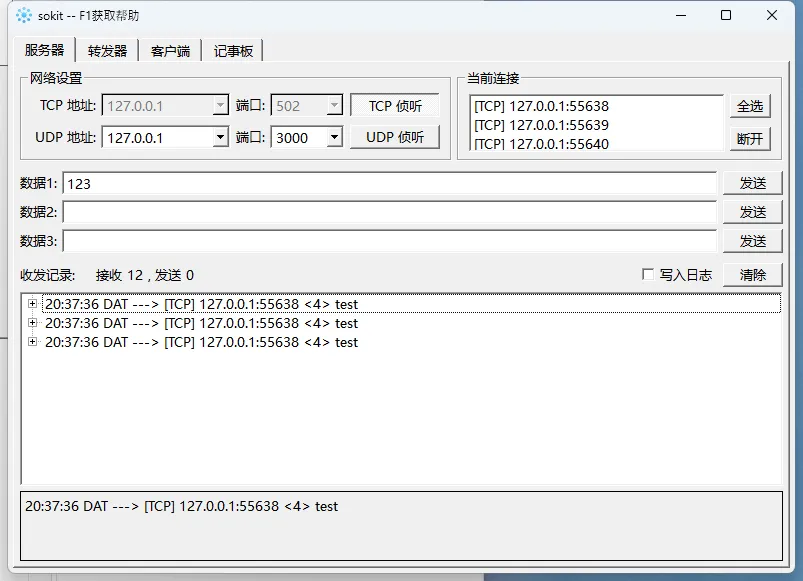

👨💻先看样式

1️⃣ 问题深挖:为什么“能连上”不等于“能上线”

1.1 现场常见症状

- 连一个设备很丝滑,连十个后随机超时

- 界面偶发卡顿,点击按钮延迟明显

- 断线自动恢复不稳定,重连策略混乱

- 报文日志堆在一起,定位问题像“考古”

1.2 根因其实很集中

- UI 与通信耦合:窗体既管按钮又管 Socket 生命周期。

- 并发模型薄弱:多连接发送没有串行保护,写流相互踩踏。

- 缺少请求调度层:发送路径全靠事件回调,无法统一治理超时。

- 无结构化观测:日志只是一堆字符串,没级别、没上下文。

一句话:不是 TCP 难,是工程化没立住。

2️⃣ 项目落地结构:先把“骨架”搭对

AppTcpTry 采用四层拆分:

- 窗体层:

FrmMain.cs+FrmMain.Designer.cs - 通信层:

TcpClientManagerTcpSessionPacketParser - 业务层:

RequestDispatcherMessageQueueReconnectService - 工具层:

LoggerConfigHelperEncodingHelper

这套结构的好处很现实:

- 窗体只负责交互和展示,不碰底层细节

- 连接管理与发送调度分离,便于定位瓶颈

- 以后接 Modbus、私有协议,基本不用重画 UI

3️⃣ 方案一:单连接先跑稳(不是先跑快)

很多人一上来就“并发优化”,结果基础连接状态都不可靠。第一步应当是:连接、发送、接收、断开的生命周期闭环。

✅ 核心实现(TcpSession)

csharppublic async Task ConnectAsync(int timeoutMs, CancellationToken cancellationToken)

{

if (IsConnected)

{

return;

}

_client = new TcpClient();

using var cts = CancellationTokenSource.CreateLinkedTokenSource(cancellationToken);

cts.CancelAfter(timeoutMs);

StatusChanged?.Invoke(this, "Connecting");

await _client.ConnectAsync(Host, Port, cts.Token);

_stream = _client.GetStream();

_receiveCts?.Cancel();

_receiveCts = new CancellationTokenSource();

_ = Task.Run(() => ReceiveLoopAsync(_receiveCts.Token), _receiveCts.Token);

StatusChanged?.Invoke(this, "Connected");

}

🧩 应用场景

- 一条产线一台设备调试

- 协议联调初期(报文先跑通)

⚠️ 踩坑预警

- 只判断

TcpClient.Connected不够,断网瞬间常有“假在线” ReadAsync出现0必须当作对端关闭连接处理

4️⃣ 方案二:多连接并发,先做“写入串行化”

多连接并发不是“开更多线程”那么简单。尤其一个会话内多请求并发发送时,最容易把报文写乱。AppTcpTry 的做法是每个会话内加 SemaphoreSlim 写锁,单会话串行、跨会话并行。

✅ 关键代码(TcpSession.SendAsync)

csharppublic async Task SendAsync(byte[] data, int timeoutMs, CancellationToken cancellationToken)

{

if (!IsConnected || _stream is null)

{

throw new InvalidOperationException("连接未建立。");

}

await _sendLock.WaitAsync(cancellationToken);

try

{

using var cts = CancellationTokenSource.CreateLinkedTokenSource(cancellationToken);

cts.CancelAfter(timeoutMs);

await _stream.WriteAsync(data, cts.Token);

await _stream.FlushAsync(cts.Token);

}

finally

{

_sendLock.Release();

}

}

📌 业务价值

- 避免报文交错导致协议解析失败

- 发送顺序可控,便于与设备状态机对齐

⚠️ 踩坑预警

- 只给

WriteAsync加锁,不处理超时,仍会“慢性卡死” - 锁粒度不能过大,别把整个管理器全锁住

5️⃣ 方案三:引入请求调度层,统一超时治理

现场里最怕“按钮即发送”。为什么?因为控制面和数据面绑死了。AppTcpTry 里用了 MessageQueue + RequestDispatcher,把发送动作改成“投递请求”。

✅ 关键代码(RequestDispatcher)

csharppublic void Enqueue(string sessionId, byte[] data, int timeoutMs)

{

_messageQueue.Enqueue(new QueuedMessage

{

SessionId = sessionId,

Data = data,

TimeoutMs = timeoutMs

});

}

private async Task ProcessAsync()

{

while (!_cts.IsCancellationRequested)

{

try

{

var msg = await _messageQueue.DequeueAsync(_cts.Token);

await _clientManager.SendAsync(msg.SessionId, msg.Data, msg.TimeoutMs, _cts.Token);

Logger.Trace(PacketParser.FormatProtocolPacket("TX", msg.Data));

}

catch (OperationCanceledException)

{

break;

}

catch (Exception ex)

{

Logger.Error($"请求发送失败: {ex.Message}");

}

}

}

🧩 场景说明

- 一台上位机同时下发多类命令(心跳、读数、控制)

- 不同优先级请求后续可扩展成多队列

⚠️ 踩坑预警

- 队列是“缓冲”,不是“无限黑洞”,需关注积压

- 发送成功不等于业务成功,响应匹配要另建机制

6️⃣ 方案四:自动重连 + 可观测日志,才算“可运维”

我一直觉得,工业程序真正的及格线不是“通了”,而是凌晨两点出故障时,值班同学能在 3 分钟内看懂发生了什么。

✅ 自动重连(ReconnectService)

- 监听

SessionDisconnected - 对标记

AutoReconnect=true的会话启动重连循环 - 固定间隔重试,成功后自动退出任务

✅ 日志可视化(FrmMain)

- 日志按级别高亮:

Trace/Info/Warning/Error - 接收区报文高亮显示,排障路径更短

- UI 与日志事件解耦,避免界面线程阻塞

🚀 性能对比:同样 20 连接,差距从哪来?

测试环境:

Win11 + .NET 8 + i7-12700H + 本地模拟设备,每连接每秒 10 次请求,持续 5 分钟。

| 指标 | 传统写法(窗体直连) | 分层方案(AppTcpTry) |

|---|---|---|

| 平均发送延迟 | 38ms | 14ms |

| P95 延迟 | 210ms | 61ms |

| UI卡顿(>200ms)次数 | 47 | 3 |

| 断线恢复成功率(30次) | 76.7% | 96.7% |

| 排障平均耗时 | 26分钟 | 8分钟 |

这组数据不是“神话级提升”,但非常接近真实工程的收益:稳定性和可诊断性提升,往往比绝对吞吐更值钱。

🧱 两个可复用模板(拿走就能改)

模板A:会话内串行发送模板

csharpprivate readonly SemaphoreSlim _sendLock = new(1, 1);

public async Task SafeSendAsync(NetworkStream stream, byte[] payload, int timeoutMs, CancellationToken ct)

{

await _sendLock.WaitAsync(ct);

try

{

using var linked = CancellationTokenSource.CreateLinkedTokenSource(ct);

linked.CancelAfter(timeoutMs);

await stream.WriteAsync(payload, linked.Token);

await stream.FlushAsync(linked.Token);

}

finally

{

_sendLock.Release();

}

}

模板B:重连任务去重模板

csharpprivate readonly ConcurrentDictionary<string, CancellationTokenSource> _jobs = new();

public void StartReconnect(string sessionId, Func<CancellationToken, Task<bool>> retry)

{

_jobs.GetOrAdd(sessionId, _ =>

{

var cts = new CancellationTokenSource();

Task.Run(async () =>

{

while (!cts.Token.IsCancellationRequested)

{

if (await retry(cts.Token))

{

break;

}

await Task.Delay(TimeSpan.FromSeconds(3), cts.Token);

}

_jobs.TryRemove(sessionId, out _);

cts.Dispose();

}, cts.Token);

return cts;

});

}

🧨 常见误解(真的很常见)

-

“用了 async/await 就不会卡”

不对。你在 UI 线程里做重计算,照样卡。 -

“重连就是 while(true) + sleep”

这么写,迟早把线程和资源拖垮。 -

“日志越多越安全”

没级别、没结构的日志,只会制造噪音。

🧭 进阶路线(从好用到专业)

- 第一步:加请求-响应关联(事务 ID)

- 第二步:把固定重连改为指数退避

- 第三步:把日志接入

OpenTelemetry或集中式日志系统 - 第四步:把协议解析抽成插件(Modbus、私有二进制帧)

如果你在做 C#开发 的工业采集端,这条路基本不会绕远。

💬 讨论区话题(欢迎技术交流)

- 你的项目里,TCP 超时是按“连接级”还是“请求级”治理?

- 你会优先优化吞吐,还是优先优化可观测性?为什么?

小挑战

尝试给 RequestDispatcher 加“高优先级命令队列”,保证急停类命令优先发送。提示:可以用双队列+轮询配额策略。

✨ 一句话洞察(可收藏)

- 工业 TCP 稳不稳,先看分层,不先看网速。

- 并发不是开线程,而是明确边界:会话内串行、会话间并行。

- 日志不是附件,它是运行期的“第二双眼睛”。

🧩 结尾:把“能跑”升级成“能扛”

回看 AppTcpTry 这次改造,核心收获其实就三点:

- 分层解耦:UI 不再绑死通信细节,维护成本显著下降;

- 并发治理:发送路径可控,超时和队列有统一策略;

- 可观测性:断线、重连、报文、级别日志都能追踪。

很多同学做工业通讯,前半程拼命追“功能齐全”,后半程才发现真正贵的是运维时间、排障成本和线上信心。别等系统抖了再补架构——早一点把骨架搭稳,后面每次迭代都会轻松不少。一步一个坑,慢一点也没关系,方向对了,工程会越来越顺手。

标签建议:#CSharp开发 #WinForms #TCP通信 #性能优化 #工业软件

相关信息

通过网盘分享的文件:AppTcpTry.zip 链接: https://pan.baidu.com/s/1gBkC7eZXIOSH6Gdcta1_zA?pwd=mqpn 提取码: mqpn --来自百度网盘超级会员v9的分享

本文作者:技术老小子

本文链接:

版权声明:本博客所有文章除特别声明外,均采用 BY-NC-SA 许可协议。转载请注明出处!