目录

在使用 ML.NET 进行机器学习项目时,SdcaLogisticRegressionBinaryTrainer 是一个常见且高效的二分类训练器(Binary Classification Trainer)。它采用随机双坐标下降法(SDCA)来训练逻辑回归模型,能够在大多数常见的二分类场景中快速、准确地完成分类任务。本文将深入探讨它的适用场景,并提供一个详细的示例代码,帮助你更好地掌握这一训练器的使用方法。

SdcaLogisticRegressionBinaryTrainer 的适用场景

二分类问题

如果你的目标是区分两个类别(如“是否有欺诈交易”、“是否会流失”等),那么 SdcaLogisticRegressionBinaryTrainer 非常适合。例如:

- 电子邮件分类:垃圾邮件 vs. 正常邮件

- 购买预测:是否会购买某产品

- 金融风控:是否违约

- 医疗诊断:是否患病

高效率、能处理大规模数据集

该训练器采用随机双坐标下降法(Stochastic Dual Coordinate Ascent),在特征数和数据量较大时,依旧能够提供高效率的训练性能。

对稀疏特征友好

在文本分类等大量稀疏特征的场景下,SdcaLogisticRegressionBinaryTrainer 能很好地处理稀疏输入,具有良好的鲁棒性和计算效率。

需要可解释性

逻辑回归本身具有可解释性,可提供特征权重来判断特征对预测结果的影响程度,为业务决策带来更直观的价值。

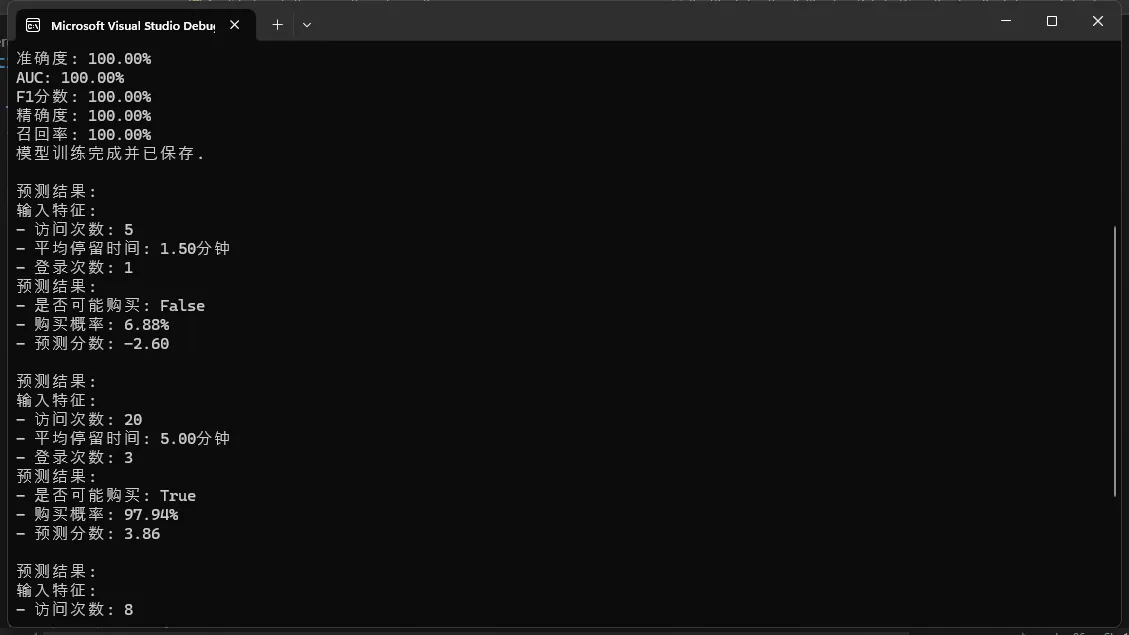

示例项目:预测用户是否会购买产品

下面我们将以一个简单示例来展示如何使用 SdcaLogisticRegressionBinaryTrainer 进行二分类预测。场景是假设我们通过用户的一些基本属性(如访问次数、停留时长等),来判断他们是否会购买某个产品。

定义数据模型

C#using System;

using System.Collections.Generic;

using System.Linq;

using System.Text;

using System.Threading.Tasks;

using Microsoft.ML.Data;

namespace AppSdcaLogisticRegressionBinaryTrainer

{

// 假设这是我们用于训练的数据集,对应每个用户的特征和标签

public class PurchaseData

{

// 访问次数

public float VisitCount { get; set; }

// 平均停留时长(分钟)

public float AverageTimeOnSite { get; set; }

// 登陆次数

public float LoginCount { get; set; }

// 是否下单(标签:1 表示购买,0 表示未购买)

[ColumnName("Label")]

public bool HasPurchased { get; set; }

}

// 预测结果输出类

public class PurchasePrediction

{

// 预测标签(二分类:true 或 false)

[ColumnName("PredictedLabel")]

public bool PredictedLabel { get; set; }

// 预测为“true”(购买)的概率

[ColumnName("Probability")]

public float Probability { get; set; }

// 分数,用于衡量离决策边界的距离

[ColumnName("Score")]

public float Score { get; set; }

}

}

构建训练管道

C#using System;

using System.Collections.Generic;

using System.Linq;

using System.Text;

using System.Threading.Tasks;

using Microsoft.ML.Trainers;

using Microsoft.ML;

namespace AppSdcaLogisticRegressionBinaryTrainer

{

public class PurchaseModelTrainer

{

private readonly MLContext _mlContext;

private const string ModelPath = "PurchaseModel.zip";

public PurchaseModelTrainer(int? seed = null)

{

_mlContext = seed.HasValue ? new MLContext(seed.Value) : new MLContext();

}

private IDataView LoadAndPrepareData(List<PurchaseData> data)

{

try

{

// 检查数据平衡性并输出统计信息

int positiveCount = data.Count(x => x.HasPurchased);

int negativeCount = data.Count(x => !x.HasPurchased);

Console.WriteLine($"数据集统计:");

Console.WriteLine($"总样本数: {data.Count}");

Console.WriteLine($"正样本数量: {positiveCount}");

Console.WriteLine($"负样本数量: {negativeCount}");

Console.WriteLine($"正负样本比例: {(double)positiveCount / negativeCount:F2}");

if (positiveCount == 0 || negativeCount == 0)

{

throw new Exception("数据集中必须同时包含正样本和负样本!");

}

return _mlContext.Data.LoadFromEnumerable(data);

}

catch (Exception ex)

{

Console.WriteLine($"数据加载错误: {ex.Message}");

throw;

}

}

private IEstimator<ITransformer> BuildTrainingPipeline()

{

var pipeline = _mlContext.Transforms.Concatenate("Features",

nameof(PurchaseData.VisitCount),

nameof(PurchaseData.AverageTimeOnSite),

nameof(PurchaseData.LoginCount))

// 添加特征标准化

.Append(_mlContext.Transforms.NormalizeMinMax("Features"))

.Append(_mlContext.BinaryClassification.Trainers.SdcaLogisticRegression(

new SdcaLogisticRegressionBinaryTrainer.Options

{

LabelColumnName = "Label",

FeatureColumnName = "Features",

MaximumNumberOfIterations = 1000, // 增加迭代次数

L2Regularization = 0.001f, // 减小正则化参数

L1Regularization = 0.001f, // 减小正则化参数

ConvergenceTolerance = 0.0001f // 提高收敛精度

}));

return pipeline;

}

public void TrainAndSaveModel(List<PurchaseData> trainingData)

{

try

{

Console.WriteLine("开始训练模型...");

// 检查并输出数据统计

PrintDataStatistics(trainingData);

// 分割数据集

var trainTestData = _mlContext.Data.TrainTestSplit(

_mlContext.Data.LoadFromEnumerable(trainingData),

testFraction: 0.2);

var pipeline = BuildTrainingPipeline();

var model = pipeline.Fit(trainTestData.TrainSet);

// 评估模型

EvaluateModel(model, trainTestData.TestSet);

// 保存模型

_mlContext.Model.Save(model, null, ModelPath);

Console.WriteLine("模型训练完成并已保存.");

}

catch (Exception ex)

{

Console.WriteLine($"训练过程中发生错误: {ex.Message}");

throw;

}

}

private void PrintDataStatistics(List<PurchaseData> data)

{

var positiveData = data.Where(x => x.HasPurchased).ToList();

var negativeData = data.Where(x => !x.HasPurchased).ToList();

Console.WriteLine("\n数据集统计:");

Console.WriteLine($"总样本数: {data.Count}");

Console.WriteLine($"正样本数: {positiveData.Count}");

Console.WriteLine($"负样本数: {negativeData.Count}");

Console.WriteLine("\n正样本统计:");

PrintFeatureStatistics(positiveData);

Console.WriteLine("\n负样本统计:");

PrintFeatureStatistics(negativeData);

}

private void PrintFeatureStatistics(List<PurchaseData> data)

{

Console.WriteLine($"访问次数: 平均={data.Average(x => x.VisitCount):F2}, " +

$"最小={data.Min(x => x.VisitCount)}, " +

$"最大={data.Max(x => x.VisitCount)}");

Console.WriteLine($"停留时间: 平均={data.Average(x => x.AverageTimeOnSite):F2}, " +

$"最小={data.Min(x => x.AverageTimeOnSite)}, " +

$"最大={data.Max(x => x.AverageTimeOnSite)}");

Console.WriteLine($"登录次数: 平均={data.Average(x => x.LoginCount):F2}, " +

$"最小={data.Min(x => x.LoginCount)}, " +

$"最大={data.Max(x => x.LoginCount)}");

}

private void EvaluateModel(ITransformer model, IDataView testData)

{

var predictions = model.Transform(testData);

var metrics = _mlContext.BinaryClassification.Evaluate(predictions);

Console.WriteLine("\n模型评估结果:");

Console.WriteLine($"准确度: {metrics.Accuracy:P2}");

Console.WriteLine($"AUC: {metrics.AreaUnderRocCurve:P2}");

Console.WriteLine($"F1分数: {metrics.F1Score:P2}");

Console.WriteLine($"精确度: {metrics.PositivePrecision:P2}");

Console.WriteLine($"召回率: {metrics.PositiveRecall:P2}");

}

public PurchasePrediction Predict(PurchaseData input)

{

if (!File.Exists(ModelPath))

{

throw new FileNotFoundException("模型文件未找到,请先训练模型。");

}

var loadedModel = _mlContext.Model.Load(ModelPath, out var _);

var predEngine = _mlContext.Model.CreatePredictionEngine<PurchaseData, PurchasePrediction>(loadedModel);

return predEngine.Predict(input);

}

}

}

运行

C#using Microsoft.ML.Data;

using Microsoft.ML;

namespace AppSdcaLogisticRegressionBinaryTrainer

{

internal class Program

{

static void Main(string[] args)

{

try

{

var trainer = new PurchaseModelTrainer(seed: 42);

var trainingData = GenerateTrainingData();

// 训练模型

trainer.TrainAndSaveModel(trainingData);

// 测试预测

var testCases = new List<PurchaseData>

{

new PurchaseData

{

VisitCount = 5,

AverageTimeOnSite = 1.5f,

LoginCount = 1

},

new PurchaseData

{

VisitCount = 20,

AverageTimeOnSite = 5.0f,

LoginCount = 3

},

new PurchaseData

{

VisitCount = 8,

AverageTimeOnSite = 2.0f,

LoginCount = 1

}

};

foreach (var testCase in testCases)

{

var prediction = trainer.Predict(testCase);

PrintPredictionResults(testCase, prediction);

}

}

catch (Exception ex)

{

Console.WriteLine($"程序执行过程中发生错误: {ex.Message}");

}

}

private static List<PurchaseData> GenerateTrainingData()

{

var random = new Random(42);

var trainingData = new List<PurchaseData>();

// 生成负样本(未购买的用户)

for (int i = 0; i < 1000; i++)

{

trainingData.Add(new PurchaseData

{

VisitCount = random.Next(1, 8),

AverageTimeOnSite = (float)(random.NextDouble() * 2.0),

LoginCount = random.Next(0, 2),

HasPurchased = false

});

}

// 生成正样本(购买的用户)

for (int i = 0; i < 1000; i++)

{

trainingData.Add(new PurchaseData

{

VisitCount = random.Next(15, 30),

AverageTimeOnSite = (float)(random.NextDouble() * 5.0 + 3.0),

LoginCount = random.Next(2, 5),

HasPurchased = true

});

}

return trainingData;

}

private static void PrintPredictionResults(PurchaseData testCase, PurchasePrediction prediction)

{

Console.WriteLine("\n预测结果:");

Console.WriteLine($"输入特征:");

Console.WriteLine($"- 访问次数: {testCase.VisitCount}");

Console.WriteLine($"- 平均停留时间: {testCase.AverageTimeOnSite:F2}分钟");

Console.WriteLine($"- 登录次数: {testCase.LoginCount}");

Console.WriteLine($"预测结果:");

Console.WriteLine($"- 是否可能购买: {prediction.PredictedLabel}");

Console.WriteLine($"- 购买概率: {prediction.Probability:P2}");

Console.WriteLine($"- 预测分数: {prediction.Score:F2}");

}

}

}

C#public void ExplainMetrics(BinaryClassificationMetrics metrics)

{

// 1. 基础准确率指标

Console.WriteLine("一、基础准确率指标:");

Console.WriteLine($"Accuracy (准确率): {metrics.Accuracy:P2}");

// - 含义:所有预测中正确的比例

// - 计算:(TP + TN) / (TP + TN + FP + FN)

// - 范围:0.0-1.0,1.0为完美

// - 场景:适用于数据集均衡的情况

// 2. AUC - ROC曲线下面积

Console.WriteLine($"AreaUnderRocCurve (AUC): {metrics.AreaUnderRocCurve:P2}");

// - 含义:模型区分正负样本的能力

// - 特点:不受样本不平衡影响

// - 范围:0.0-1.0

// - 参考值:

// > 0.9:优秀

// 0.8-0.9:良好

// 0.7-0.8:一般

// < 0.7:较差

// 3. F1 Score

Console.WriteLine($"F1Score: {metrics.F1Score:P2}");

// - 含义:精确率和召回率的调和平均数

// - 计算:2 * (Precision * Recall) / (Precision + Recall)

// - 特点:同时考虑精确率和召回率

// - 使用:样本不平衡时比Accuracy更有参考价值

// 4. 精确率指标

Console.WriteLine("\n二、精确率指标:");

Console.WriteLine($"PositivePrecision (正例精确率): {metrics.PositivePrecision:P2}");

// - 含义:预测为正例中真实正例的比例

// - 计算:TP / (TP + FP)

// - 重要性:反映误报率

Console.WriteLine($"NegativePrecision (负例精确率): {metrics.NegativePrecision:P2}");

// - 含义:预测为负例中真实负例的比例

// - 计算:TN / (TN + FN)

// 5. 召回率指标

Console.WriteLine("\n三、召回率指标:");

Console.WriteLine($"PositiveRecall (正例召回率): {metrics.PositiveRecall:P2}");

// - 含义:实际正例中被正确预测的比例

// - 计算:TP / (TP + FN)

// - 重要性:反映漏报率

Console.WriteLine($"NegativeRecall (负例召回率): {metrics.NegativeRecall:P2}");

// - 含义:实际负例中被正确预测的比例

// - 计算:TN / (TN + FP)

// 6. 损失函数

Console.WriteLine("\n四、损失函数:");

Console.WriteLine($"LogLoss (对数损失): {metrics.LogLoss:F4}");

// - 含义:预测概率的准确性度量

// - 特点:对错误预测的概率值惩罚较大

// - 范围:0到∞,越小越好

Console.WriteLine($"EntropyLoss (熵损失): {metrics.LogLoss:F4}");

// - 含义:与LogLoss相同

// - 使用:评估概率预测的质量

}

C#// 场景1:追求高精度

var highAccuracyOptions = new SdcaLogisticRegressionBinaryTrainer.Options

{

LabelColumnName = "Label",

FeatureColumnName = "Features",

MaximumNumberOfIterations = 2000, // 更多迭代

L2Regularization = 0.0001f, // 更少正则化

L1Regularization = 0.0001f, // 更少正则化

ConvergenceTolerance = 0.00001f // 更高精度要求

};

// 场景2:快速训练

var fastTrainingOptions = new SdcaLogisticRegressionBinaryTrainer.Options

{

LabelColumnName = "Label",

FeatureColumnName = "Features",

MaximumNumberOfIterations = 500, // 更少迭代

L2Regularization = 0.01f, // 更强正则化

L1Regularization = 0.01f, // 更强正则化

ConvergenceTolerance = 0.001f // 更宽松的精度要求

};

// 场景3:平衡配置(当前代码使用的配置)

var balancedOptions = new SdcaLogisticRegressionBinaryTrainer.Options

{

LabelColumnName = "Label",

FeatureColumnName = "Features",

MaximumNumberOfIterations = 1000, // 适中迭代次数

L2Regularization = 0.001f, // 适中正则化

L1Regularization = 0.001f, // 适中正则化

ConvergenceTolerance = 0.0001f // 适中精度要求

};

当前代码中的参数配置是一个比较平衡的选择:

- 迭代次数设为1000,给予模型足够的训练机会

- 收敛容差设为0.0001,要求较高的精度

- L1和L2正则化都设为0.001,提供适度的正则化效果

这个配置适合:

- 数据量适中的场景

- 需要较好精度的预测任务

- 训练时间和精度需要平衡的情况

如果需要调整,可以根据具体需求:

- 提高精度:减小正则化参数,增加迭代次数

- 加快训练:增加正则化参数,减少迭代次数

- 防止过拟合:增加正则化参数

- 减少欠拟合:减小正则化参数

总结

SdcaLogisticRegressionBinaryTrainer 提供了快速、高效并且对稀疏特征友好的二分类模型训练方式。它在可解释性要求较高、特征数量较多的任务中具有显著优势,也非常适合需要高并发和实时预测响应的在线服务。希望这篇文章的示例能帮助你快速上手 SDCA 逻辑回归模型在 ML.NET 中的应用,助力业务场景的落地与优化。

如果想进一步提升模型表现,可以尝试以下方向:

- 对特征进行更加丰富的预处理(比如提取交互特征、使用正则化等)。

- 使用不同的训练器(如 FastTree、LightGbm)进行对比测试。

- 结合超参数调优(Hyperparameter Tuning)来寻求最优的配置。

祝你在 ML.NET 的探索之旅中取得好成绩!

本文作者:技术老小子

本文链接:

版权声明:本博客所有文章除特别声明外,均采用 BY-NC-SA 许可协议。转载请注明出处!